Improving Viewing Experiences of First-Person Shooter Gameplays with Automatically-Generated Motion Effects

논문 정보

- 제목: Improving Viewing Experiences of First-Person Shooter Gameplays with Automatically-Generated Motion Effects

- 저자: Gyeore Yun, Sangyoon Han, Hyoseung Lee, Seungmoon Choi (Pohang University of Science and Technology)

- 학회/저널: CHI Conference on Human Factors in Computing Systems (CHI '21)

- 발행일: 2021-05-08

- DOI: 10.1145/3411764.3445358

- 주요 연구 내용: 1인칭 슈팅(FPS) 게임 시청 경험을 향상시키기 위해, 게임의 시청각(audiovisual) 스트림을 분석하여 자동으로 모션 효과를 생성하는 두 가지 알고리즘을 제안함. 첫 번째는 컴퓨터 비전 기술을 이용해 카메라 움직임을 추정하여 캐릭터의 이동을 표현, 두 번째는 딥러닝 모델로 총소리를 탐지하여 총기 반동 효과를 생성함.

- 주요 결과 및 결론: 사용자 연구 결과, 제안된 모션 효과가 게임 시청의 즐거움과 몰입감을 유의미하게 향상시킴. 특히 캐릭터 움직임과 총기 발사 효과를 결합했을 때(ME-COM) 시너지 효과를 보이며 가장 높은 몰입감과 선호도를 얻음. 모션 효과는 시청자의 게임 집중력을 방해하지 않았으나, 피로도는 다소 증가시키는 것으로 나타남.

- 기여점: FPS 게임에 특화된 두 가지 모션 합성 알고리즘을 설계하고 통합했으며, 자동으로 생성된 다감각 효과가 e스포츠 시청 경험에 실질적인 이점을 제공한다는 경험적 증거를 제시함. 이는 개발자의 수동 작업 없이 다양한 게임에 4D 효과를 적용할 수 있는 확장 가능한 방법을 제안한다는 점에서 의의가 있음.

요약

초록

수많은 사람들이 e스포츠 경기장에서나 집에서 비디오 게임플레이를 시청하는 것을 즐긴다. 본 연구는 다감각 자극을 제공하여 게임플레이 시청 경험을 향상시키는 방법을 모색한다. 모션 체어를 사용하여 1인칭 슈팅(FPS) 게임플레이를 시청하는 관객에게 시청각 스트림으로부터 자동으로 생성된 모션 효과를 제공한다. 이 모션 효과는 게임 캐릭터의 움직임과 총기 발사 액션을 표현한다. 컴퓨터 비전 기술과 딥러닝을 사용하여 개발된 이러한 모션 효과의 계산 알고리즘을 설명하고, 사용자 연구를 통해 제안된 방법이 FPS 게임플레이 시청 경험을 크게 향상시킨다는 것을 입증한다.

서론

비디오 게임 시청은 전 세계적으로 인기 있는 멀티미디어 경험이 되었고, 이와 동시에 모션, 진동, 바람 등 다양한 물리적 효과를 제공하는 4D 플랫폼의 활용도 증가하고 있다. 이 두 가지 기술을 결합하여 e스포츠 시청 경험을 향상시키는 것은 자연스러운 흐름이다. 4D 효과를 게임에 적용하는 방법은 개발자가 직접 코드를 삽입하는 수동 방식과 게임의 시청각 스트림을 분석하여 자동으로 생성하는 방식이 있다. 수동 방식은 품질이 높지만 비용과 전문성이 요구되는 반면, 자동 생성 방식은 모든 게임에 저비용으로 적용할 수 있다는 장점이 있다. 본 연구는 FPS 게임을 대상으로 캐릭터의 주요 행동인 '움직임'과 '총기 발사'를 강조하는 모션 효과를 자동으로 생성하고, 이것이 시청자의 경험을 향상시키는지 검증하고자 한다.

모델 아키텍처 / 방법론

본 연구는 캐릭터의 움직임(ME-MOV)과 총기 발사(ME-GUN)를 위한 두 가지 모션 효과 생성 알고리즘을 제안한다.

본 연구는 캐릭터의 움직임(ME-MOV)과 총기 발사(ME-GUN)를 위한 두 가지 모션 효과 생성 알고리즘을 제안한다.

- 핵심 구조/방법 1: 캐릭터 움직임을 위한 모션 효과 (ME-MOV)

- FPS 게임에서 화면의 움직임은 캐릭터의 움직임과 동일하므로, 가상 카메라의 움직임을 추정하여 모션 체어의 움직임으로 변환한다. 이 과정은 기존 연구의 파이프라인을 따르되, 실시간 처리에 적합하도록 계산 속도를 크게 향상시켰다.

- 주요 구성 요소:

- Optical Flow 추정: 두 개의 연속된 비디오 프레임 간의 대응점을 찾는다. 계산 병목 현상을 해결하기 위해 GPGPU로 가속되는 Nvidia Optical Flow SDK를 사용했다.

- 특징점 선택 및 아웃라이어 제거: 고속 코너 검출 알고리즘(FAST)으로 특징점을 추출하고, RANSAC을 통해 움직이는 객체와 같은 아웃라이어를 제거하며 Fundamental Matrix를 계산한다. 특징점 수()와 재투영 임계값()을 조절하여 속도와 정확도를 조절한다.

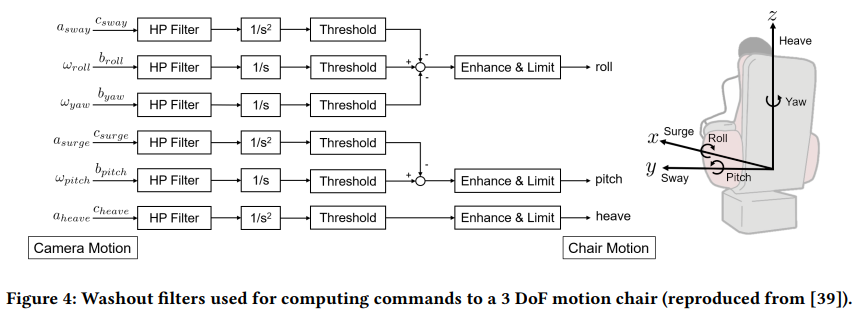

- 모션 추정 및 필터링: 추정된 카메라의 선형 가속도와 각속도는 Washout Filter를 통과하여 모션 체어의 물리적 한계 내에서 급격한 움직임을 생성하는 명령으로 변환된다. 논문의 Figure 4는 6-DoF 카메라 움직임을 3-DoF(roll, pitch, heave) 모션 체어 명령으로 변환하는 과정을 보여준다.

- 핵심 구조/방법 2: 총기 발사를 위한 모션 효과 (ME-GUN)

- 게임 오디오 스트림에서 플레이어 캐릭터의 총소리를 탐지하고, 미리 설계된 모션 프로파일을 통해 총기 반동을 시뮬레이션한다.

- 주요 구성 요소:

- 총소리 탐지: 특정 캐릭터의 총소리와 비-총소리 데이터를 수집하여 딥러닝(DNN) 분류기를 학습시킨다. 화면에 표시되는 총알 수를 기준으로 정확한 총기 발사 시점을 레이블링하여 데이터셋을 구축했다. 분류기는 6개의 레이어와 256개의 은닉 유닛을 가지며, 0.995라는 높은 후방 확률 임계값을 사용하여 오탐지를 줄였다.

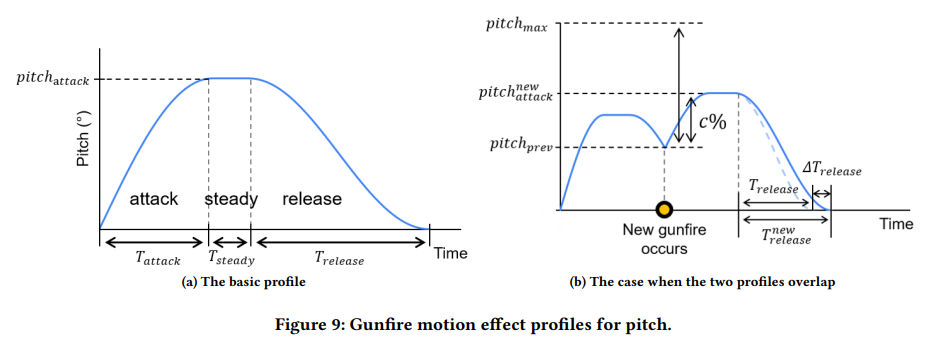

- 모션 렌더링: 총기 반동은 'attack', 'steady', 'release'의 세 단계로 구성된 모션 프로파일(논문의 Figure 9a 참조)을 통해 주로 pitch 축의 움직임으로 표현된다. 짧은 시간 내에 여러 발의 총이 발사될 경우, 프로파일이 겹치게 되는데 이때 모션 체어의 가동 범위를 넘지 않도록 다음과 같이 동적으로 피치 값과 복귀 시간을 조절한다.

- 수식:

- 새로운 공격 단계의 최대 피치 값()은 이전 피치 값()을 기준으로 남은 가동 범위의 일정 비율(c%) 만큼만 증가시킨다:

- 복귀 시간()은 최대 피치 값에 비례하여 증가시켜 움직임이 너무 급격해지는 것을 방지한다:

- 단조로움을 피하고 반동 효과를 강화하기 위해, pitch 값이 클수록 더 큰 범위의 무작위적인 roll 축 움직임을 추가한다.

실험 결과

- 주요 데이터셋: 'Overwatch' 게임플레이 영상(V1, V2, V3)과 Unreal Engine으로 제작한 자체 FPS 게임 영상(V4)을 사용했다. 사용자 연구에는 가장 역동적인 장면을 포함한 V1과 V2가 사용되었다.

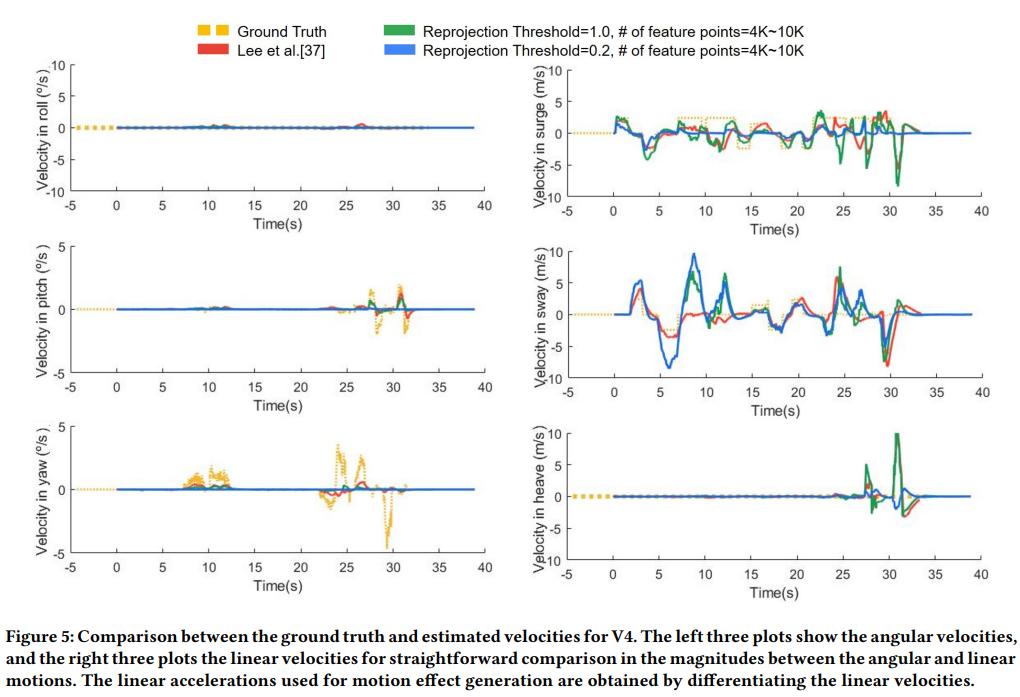

- 핵심 성능 지표:

- ME-MOV 성능: 제안된 알고리즘은 기존 방식보다 약 15배 빠른 Optical Flow 연산 속도를 보였으며, RANSAC 단계 또한 크게 개선되어 대부분의 테스트 케이스에서 30fps 이상의 실시간 처리 성능을 달성했다. Ground Truth 데이터와 비교했을 때, 속도 개선에도 불구하고 추정된 모션의 품질은 유사하게 유지되었다(논문의 Figure 5 참조).

- ME-GUN 성능: DNN 기반 총소리 탐지기는 V1 영상에서 95%의 명중률과 5%의 오탐지율을 기록하여, 기존 음향 심리(psychoacoustic) 기반 방식보다 우수한 성능을 보였다. 연산 속도 또한 샘플 당 0.16ms로 매우 빨랐다.

- 사용자 연구 결과: 24명의 참가자를 대상으로 '효과 없음(NONE)', '움직임 효과(ME-MOV)', '총기 발사 효과(ME-GUN)', '결합 효과(ME-COM)' 네 가지 조건에서 시청 경험을 평가했다.

- 즐거움 및 몰입감: 모든 모션 효과는 '효과 없음' 조건보다 유의미하게 높은 즐거움과 몰입감을 제공했다. 특히 ME-COM은 ME-MOV나 ME-GUN 단독 조건보다 몰입감이 월등히 높아 시너지 효과를 입증했다.

- 선호도 및 조화: 참가자들은 ME-COM을 가장 선호했으며, 시청각 정보와 가장 잘 조화된다고 평가했다.

- 피로도 및 집중력: 모션 효과는 피로도를 증가시켰으나(특히 ME-GUN과 ME-COM), 게임 시청의 주된 목적인 집중력에는 유의미한 영향을 미치지 않았다.

결론

본 연구는 FPS 게임플레이의 시청각 스트림으로부터 캐릭터의 움직임과 총기 발사를 표현하는 모션 효과를 자동으로 생성하는 알고리즘을 제안하고, 그 효과를 성공적으로 입증했다. 사용자 연구를 통해 이러한 모션 효과, 특히 두 가지를 결합한 효과가 시청자의 즐거움과 몰입감을 크게 향상시킨다는 것을 확인했다. 이는 e스포츠 시청과 같은 새로운 미디어 경험에 4D 기술을 효과적으로 적용할 수 있는 실용적이고 확장 가능한 방법을 제시했다는 점에서 중요한 기여를 한다.